15:00 / 05 июля 2025

Последний год в медиа все чаще появляются новости о судебных разбирательствах между творцами и компаниями, обучающими свои нейросети на их произведениях. С точки зрения авторов, ИИ отбирают у них работу и заказчиков, незаконно обучаясь на произведениях. IT Speaker узнал у экспертов в области ИТ, права и специалистов из киносферы о законности использования продуктов творческой и интеллектуальной деятельности для обучения нейросетей, а также методах защиты своих произведений.

Нейросети копируют голоса дикторов, внешний вид и мимику актеров, технику живописи, музыкальный и даже литературный стиль. От «воровства» произведений не застрахованы представители всех творческих профессий и искусства, включая писателей, музыкантов, фотографов, художников и дизайнеров.

В январе текущего года художники Сара Андерсен, Келли МакКернан и Карла Ортис подали коллективный иск против создателей Midjourney и Stable Diffusion. Они утверждают, что платформы нарушили права «миллионов художников», обучая свои инструменты ИИ пяти миллиардам изображений, извлеченных из сети без согласия авторов. Генераторы изображений позволяют создавать произведения, повторяющие стиль конкретных художников.

Дело помогают вести типограф Мэтью Баттерик и юридическая фирма Джозефа Савери, которые двумя месяцами ранее взялись за похожее разбирательство. От имени четырех пользователей юристы подали иск в суд на Microsoft, ее дочернюю компанию GitHub и делового партнера OpenAI. Жалоба касается модели программирования ИИ CoPilot, которая обучается на общедоступных строках кода. Программисты уверены, что инструмент основан на «пиратстве программного обеспечения» и специально не указывает авторство исходного фрагмента кода.

Все три компании просят суд отклонить иск, утверждая, что претензии истцов основываются на «гипотетических событиях» и не описывают, какой вред инструмент причинил им лично.

В конце 2022 года пользователи устроили бойкот платформе ArtStation – популярному онлайн-портфолио и бирже профессиональных художников, дизайнеров и иллюстраторов, работающих в геймдеве, киносфере и комиксах. Они заметили, что на стартовой странице сайта рядом с произведениями реальных авторов все чаще стали появляться изображения, сгенерированные ИИ. Кроме того, художники стали подозревать, что на основе их публикаций обучают нейросети.

Негативная реакция переросла в полноценный протест. Некоторые пользователи объявили об уходе и удалили свой контент с платформы. Другие публиковали картинки с лозунгом «Нет изображениям, сгенерированным ИИ», заполнив ими всю галерею. В ответ ArtStation начал скрывать изображения с протестами против артов нейросетей.

Позже платформа ввела специальный тег NoAI, скрывающий контент нейросетей, а также добавила в правила пункт о запрете использования работ пользователей для обучения ИИ.

Бум громких исков и даже массовых протестов против использования нейросетями произведений пришелся на лето этого года. С июля актеры Голливуда и американского телевидения объявили о начале забастовки, в рамках которой они требуют повышения зарплат и ограничений на использование ИИ в кинопроизводстве.

Киностудии пытались получить цифровые копии актеров, чтобы создавать фильмы с помощью компьютерной графики. Предложение голливудских студий напомнило один из эпизодов сериала «Черное зеркало», где стриминговая платформа использует в неприглядном виде образ Сальмы Хайек.

Глава гильдии SAG-AFTRA Дункан Крэбтри-Ирландия назвал инициативу студий лицемерием. Он уверен, что киногиганты хотят завладеть «оцифрованной харизмой», интеллектуальной собственностью знаменитостей и бесконечно использовать их в любых проектах без согласия и компенсаций.

В конце июля за нарушение авторских прав иск в суд на OpenAI (разработчик нейросети ChatGPT) и Meta (разработчик LLaMA, запрещена в РФ) подали американские писатели Кристофер Голден, Ричард Кадри и сценарист-комик Сара Сильверман. Они уверены, что нейросети обучались на наборах данных из пиратских сайтов, таких как Bibliotik, Library Genesis и Z-Library. Авторы утверждают, что они не давали согласия на использование своих книг в качестве учебного пособия для моделей ИИ.

Стороны вышеупомянутых конфликтов пока не пришли к договоренностям, которые бы устроили всех, поэтому говорить о том, чем завершатся споры, пока рано. Однако можно предположить, чем они могут обернуться для судебной практики, и как отразиться на бизнес-среде. Но прежде попробуем разобраться в нормах права, актуальных для представителей искусства и создателей нейросетей.

В современном мире защитить произведение, голос, изображение становится все сложнее, особенно учитывая доступность и распространение данных в онлайн-среде. Сеть кишит примерами использования синтеза голосов, фотографий, мимики знаменитостей для создания треков, рекламы и кинокартин. Например, нейросеть озвучила песню Toxicity группы System of a Down голосом советского Винни Пуха – артиста Евгения Леонова, нейросетевой Егор Летов исполнил песню «Знаешь ли ты» певицы МакSим, а в биографическом фильме нейросеть «сыграет» Владимира Высоцкого. Это поднимает вопрос не только о том, как защитить свои данные от создания нейрокопий, но и произведения людей, ушедших из жизни.

Как отметил директор студии озвучки «Кириллица» Валерий Довбня, хоть законодательно результаты интеллектуальной деятельности подлежат защите, но синтез голоса или внешнего вида выходит за рамки этой парадигмы, поскольку не является чисто интеллектуальным продуктом. Это своеобразное слияние технологий и записанных или отснятых данных.

Советник директора Пермской государственной художественной галереи по правовым вопросам Владимир Куранов поясняет, что при создании какого-либо продукта может быть использован результат интеллектуальной деятельности (РИД) другого человека, но только в том случае, если такое право предоставлено. Для этого необязательно производить отчуждение исключительного (имущественного авторского) права в полном объеме (аналогично продаже вещи). Достаточно заключить лицензионный договор (похож на договор аренды имущества), в котором автор оговаривает – на каких условиях, в каком объеме, какими способами, на какой срок, на какой территории он разрешает использовать результат своего творчества иным лицам (в том числе, для создания иных произведений).

«Например, автор разрешает создать сценарий на основе своего романа или предоставляет возможность зарегистрировать созданное им изображение в качестве товарного знака иного лица», – говорит специалист.

Он подчеркнул, что право на изображение человека регулируется иными нормами, нежели интеллектуальная собственность. Гражданин вправе давать разрешение на обнародование и использование своего произведения (фото, видео, картины). Однако из этого правила есть исключения:

– Если изображение используется в связи с общественно-значимым интересом. Речь идет о фото политиков, государственных деятелей, звезд спорта, деятелей культуры, и при этом это использование связано не с их частной жизнью).

– Если съемка производилась в общественных пространствах, открытых для свободного посещения (площадь, открытый судебный процесс, предприятия с режимом работы) или на публичных мероприятиях (конференция, спектакль). И при этом гражданин не является основным объектом съемки (цель – снять мероприятие, а не конкретную персону).

– При позировании за плату (речь о модельном бизнесе).

Если товар произведен с использованием изображения человека, а он не давал на это своего согласия, то такой товар может быть изъят из оборота и уничтожен на основании судебного решения.

Вопрос обучения ИИ на основе изображений людей прямо в российском законодательстве не урегулирован. Поэтому Куранов считает, что такой способ использования стоит добавить в список. «Как правило, в Европе и США проигрыш подобных дел приводит к уточнению политики компании. Но единичный случай вряд ли приведет к корректировке законодательства. Учитывая, что в правовых нормах существует лакуна, пробел, не понятно, на каких основаниях можно использовать, например, картины художников для обучения нейросети», – рассуждает эксперт.

Юрист Ростовской областной организации Общероссийского Профсоюза образования Вероника Старцева в свою очередь утверждает, что несмотря на то, что интернет предоставляет возможность увидеть фотографии, видео, музыку, аудиозаписи других людей или компаний, исключительные права на эти РИД все равно имеют своих правообладателей (тех лиц, у которых есть исключительные права них).

Менеджер ИТ-проектов «Самокат» Юрий Недре рассказал, что фирма может продавать продукты на основе голоса, внешности или интеллектуальной деятельности человека, если это не нарушает законодательство, и если у нее есть соответствующие права на использование этих данных.

Также он объяснил, что в России и во многих других странах контент, размещенный в интернете в открытом доступе, обычно считается общедоступным. Использование такого контента для обучения ИИ, как правило, не нарушает авторских прав.

С ним согласен глава сервиса «Патрикеев и партнеры» Павел Патрикеев. Он добавил, что с точки зрения текущего законодательства, при условии надлежащего получения согласия и прозрачного отражения данного права в соответствующем соглашении, компании могут перепродавать третьим лицам РИД. Актеры, дикторы и модели передают права на использование своего изображения и голоса, сотрудники ИТ-компаний – права на использование результатов их разработок.

Партнер юридическая фирма «Скриптолекс» Дмитрий Овсянников пояснил, законность продажи третьим лицам продуктов на основе голоса, внешности или результата интеллектуальной деятельности человека – зависит от содержания договора и фактических обстоятельств. Но на сегодняшний момент большинство объектов исключительных прав отчуждаемы (могут быть изъяты у владельца).

«Если контент размещен в сети в свободном доступе (законно), необходимо смотреть условия лицензионного договора (правила платформы и пр.). Для того, чтобы гарантированно запретить использовать ваш контент – необходимо (в договоре – прим. IT Speaker) прописать максимально подробно и детально, в каких случаях его запрещено использовать. Если ИИ незаконно использует ваши данные, то потребуется доказать массу тяжело доказываемых обстоятельств, в том числе, что именно ваш контент был использован в ИИ (экспертиза), причинно-следственную связь, наличие ущерба и прочее», – говорит адвокат.

Как разъяснила юрист Nextons Екатерина Тытюк, все зависит от конкретных формулировок договора. Однако если сторонами действительно было достигнуто соглашение по всем существенным условиям, препятствий к заключению таких сделок – продажи продуктов ИИ – в законе нет.

При этом собеседница IT Speaker советует помнить о том, что если речь идет о биометрических персональных данных (например, о голосе или изображении), подлежат применению также специальные положения Федерального закона от 27.07.2006 N 152-ФЗ (ред. от 06.02.2023) «О персональных данных». Соответственно, для использования голоса требуется согласие на их обработку.

По мнению директора студии «Кириллица» Валерия Довбни, случаи судебных споров между представителями искусства и владельцами ИИ подчеркивают необходимость тщательного анализа договоров о сотрудничестве. Он уверен, что правила и регулирование в этой технологичной области будут развиваться, а актеры и художники должны быть готовы адаптироваться к изменяющейся среде.

Дмитрий Овсянников считает, что вопрос защиты произведений искусства от машин в большей степени лежит не в правовой, а в технической стороне вопроса. По его словам, самый простой способ «объяснить» владельцам нейросетей, что авторский материал нельзя использовать в процессе обучения и агрегации данных в ИИ, – ограничить доступ машины к материалу.

Юрист Старцева уверена, что со временем споров между авторами произведений и разработчиками нейросетей будет становиться только больше.

«Учитывая темпы развития ИИ, нам нужен отдельный закон «Об использовании искусственного интеллекта», который бы как-то регламентировал использование нейросетей в работе с РИД и, если такое возможно, биометрией. Пока что нам остается наблюдать за судебной практикой, которая еще не успела сложиться», – резюмирует юрист Старцева.

Поделиться новостью

15:00 / 05 июля 2025

13:00 / 05 июля 2025

11:00 / 05 июля 2025

20:20 / 04 июля 2025

Boeing разработает спутники ядерной связи для США

Boeing разработает спутники ядерной связи для США

15:00 / 05 июля 2025

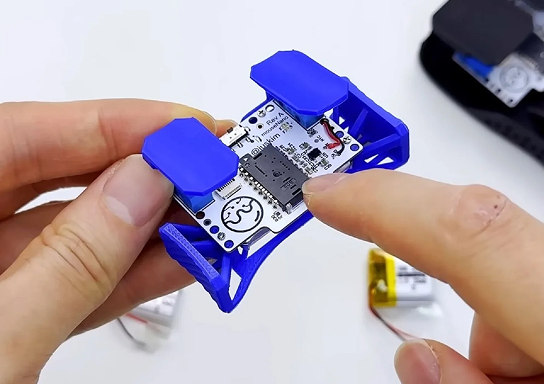

Энтузиаст создал самую маленькую игровую мышь

Энтузиаст создал самую маленькую игровую мышь

13:00 / 05 июля 2025

Foxconn и Kawasaki создали медицинского робота

Foxconn и Kawasaki создали медицинского робота

11:00 / 05 июля 2025

Wahelp создала ИИ-помощника для ведения бизнеса

Wahelp создала ИИ-помощника для ведения бизнеса

20:00 / 04 июля 2025